联邦学习相关内容简介

联邦学习

联邦机器学习(Federated Machine Learning),简称为联邦学习(Federated Learning)是谷歌在 2016 年提出的概念,它本质上是一种保护隐私的多方协作机器学习框架, 它允许参与方建立一个联合训练模型,但参与方均在本地维护其底层数据而不将原始数据进行共享。

多个数据拥有方 \( F_i(i=1,2,…,N) \) 的目的是将各自的数据 $D_i$ 联合,共同训练机器学习模型。传统做法是把数据整合到一方形成全局数据集 $D = \{D_i,i=1,2,…,N\} $,并利用 $D$ 训练生成模型 $ M_{sum} $。然而,该方案因违背数据隐私保护条例而难以实施。为了解决这一问题,联邦学习思想的定义如下

联邦学习是指使得这些数据拥有方 $F_i$ 在不用给出己方数据 $D_i$ 的情况下也可进行模型训练并得到全局模型 $ M_{fed} $ 的计算过程,并能够保证模型 $ M_{fed} $ 的效果 $ V_{fed} $ 与传统模型 $ M_{sum} $ 的效果 $V_{sum}$ 间的差距足够小,即

\[| V_{fed} - V_{sum} | < \delta\]其中,$\delta$ 为设定的小正量值。

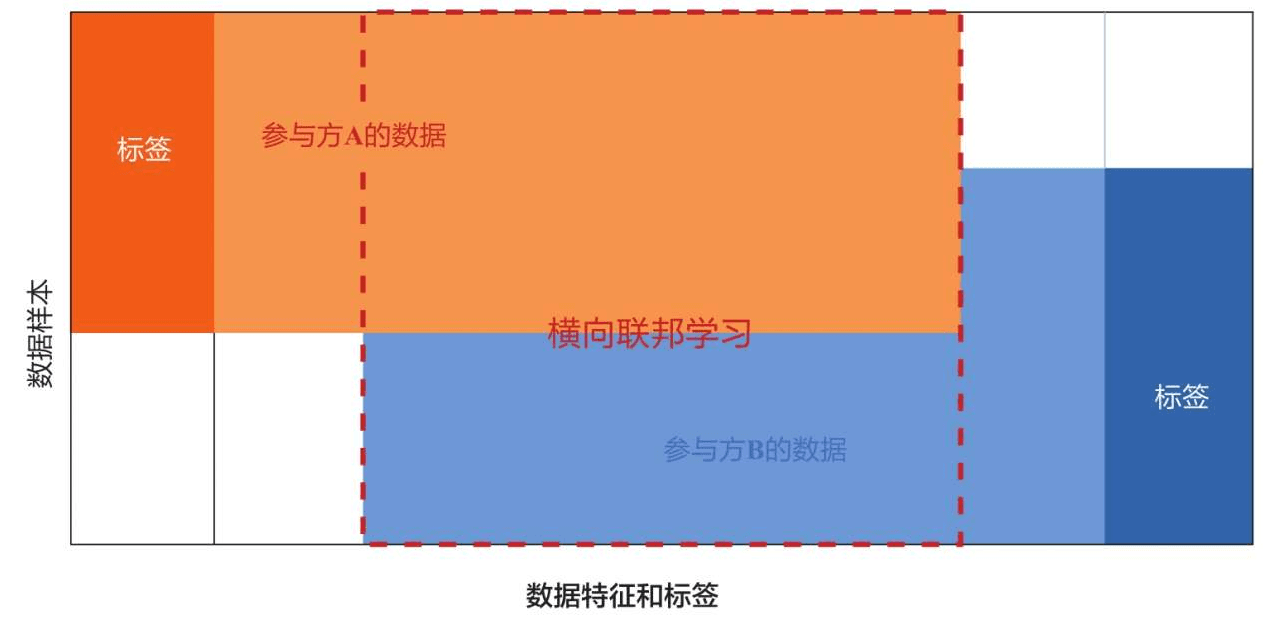

横向联邦学习适用于联邦学习的参与方的数据有重叠的数据特征,即数据特征在参与方之间是对齐的,但是参与方拥有的数据样本是不同的。

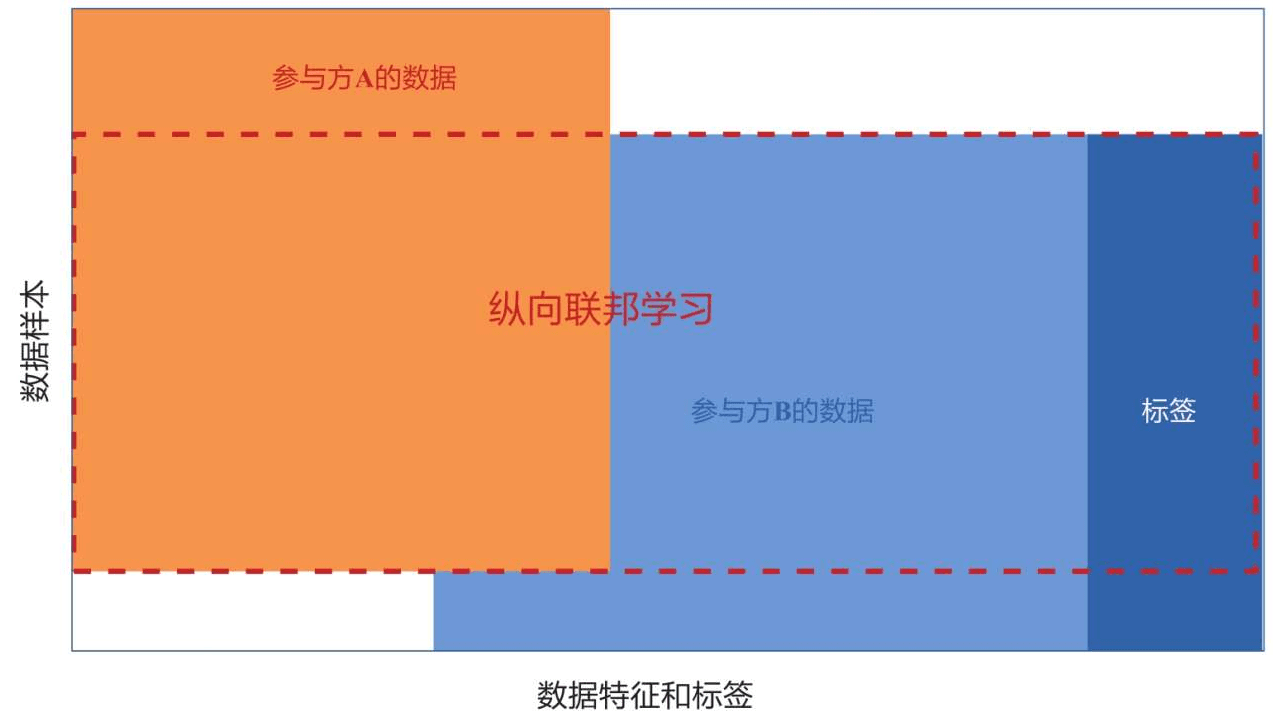

纵向联邦学习适用于联邦学习参与方的训练数据有重叠的数据样本,即参与方之间的数据样本是对齐的,但是在数据特征上有所不同。

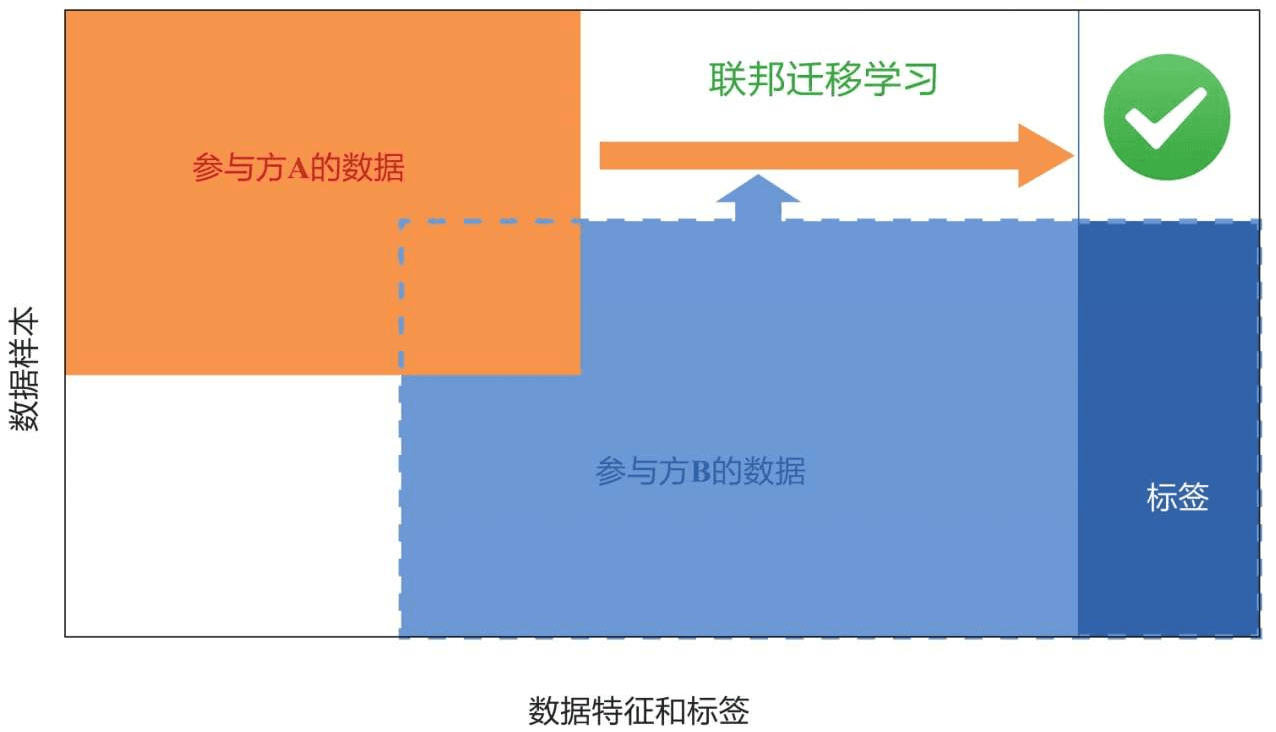

联邦迁移学习适用于参与方的数据样本和数据特征重叠都很少的情况。